引言

2026年3月18日,MiniMax正式发布M2.7模型。这是该公司第一个让模型深度参与迭代自己的模型,标志着AI自我进化能力的重大突破。

在M2系列模型发布后的几个月里,MiniMax收到了大量用户反馈和建议。要在已经很快的迭代速度上继续加速,唯一的途径就是——让模型参与迭代过程本身。

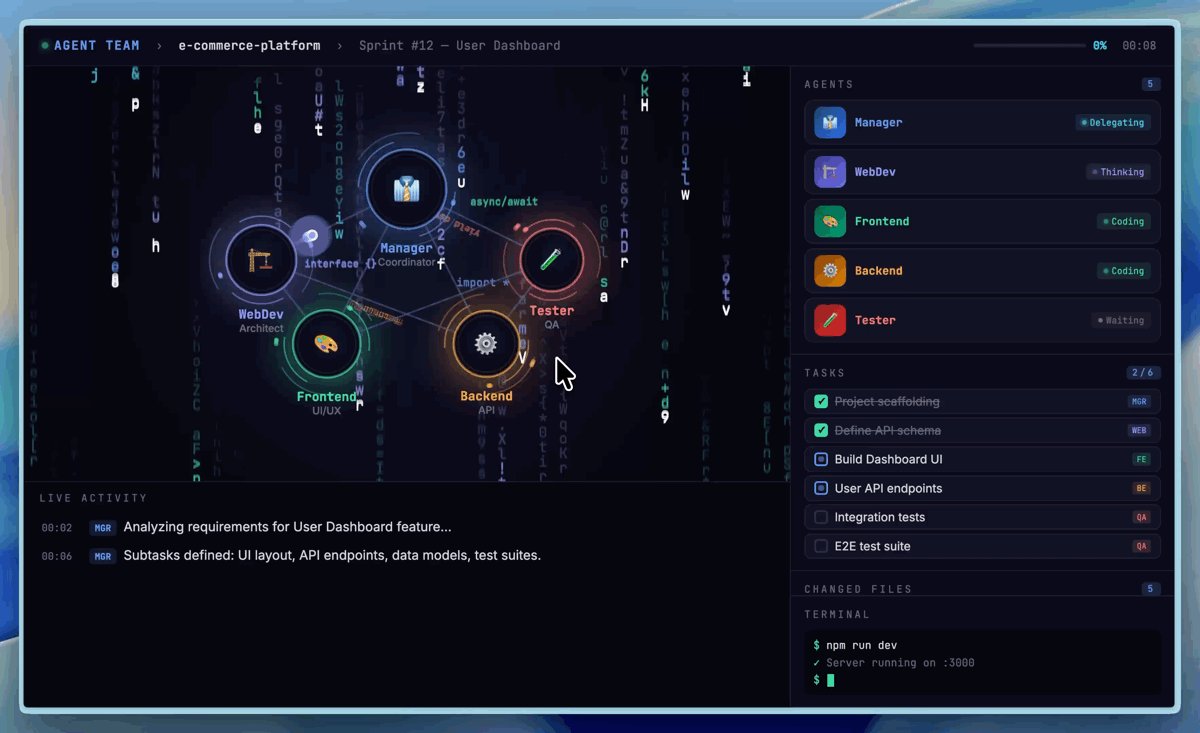

M2.7的核心亮点在于能够自行构建复杂Agent Harness,基于Agent Teams、复杂Skills、Tool Search Tool等能力完成高度复杂的生产力任务。在研发M2.7的过程中,MiniMax基于模型构建强化学习Harness中的数十个复杂skills,更新自己的memory,驱动模型自身的强化学习,并基于结果优化强化学习过程和Harness。

![[资讯] MiniMax M2.7 发布 - 开始走向自我进化的模型](https://wn.zmoyun.com/wp-content/uploads/2026/03/1774013107-m2-7-hero.jpg)

核心能力升级

软件工程:追平一线水准

在软件工程领域,M2.7已具备国际一线模型水准:

- SWE-Pro:56.22%,追平GPT-5.3-Codex

- SWE Multilingual:76.5%

- Multi SWE Bench:52.7%

- Terminal Bench 2(系统认知):57.0%

- VIBE-Pro(端到端项目交付):55.6%,几乎与Opus 4.6持平

这意味着无论是Web、Android、iOS还是Simulation类需求,都可以直接交给M2.7完成。

专业办公:开源最高水平

在GDPval-AA的ELO评测中,M2.7得分1495,为开源最高,仅次于Opus 4.6、Sonnet 4.6和GPT5.4。

M2.7对Office三件套Excel/PPT/Word的复杂编辑能力显著提升,既能基于模板和skills直接生成文件,也能遵从用户交互指令做多轮高保真编辑。

复杂Skills遵循率

在MM Claw测试中,M2.7在40个复杂skills(超过2000 Token)的场景下,仍能保持97%的skills遵循率。在OpenClaw的使用中,M2.7已接近Sonnet 4.6水准,正确率达62.7%。

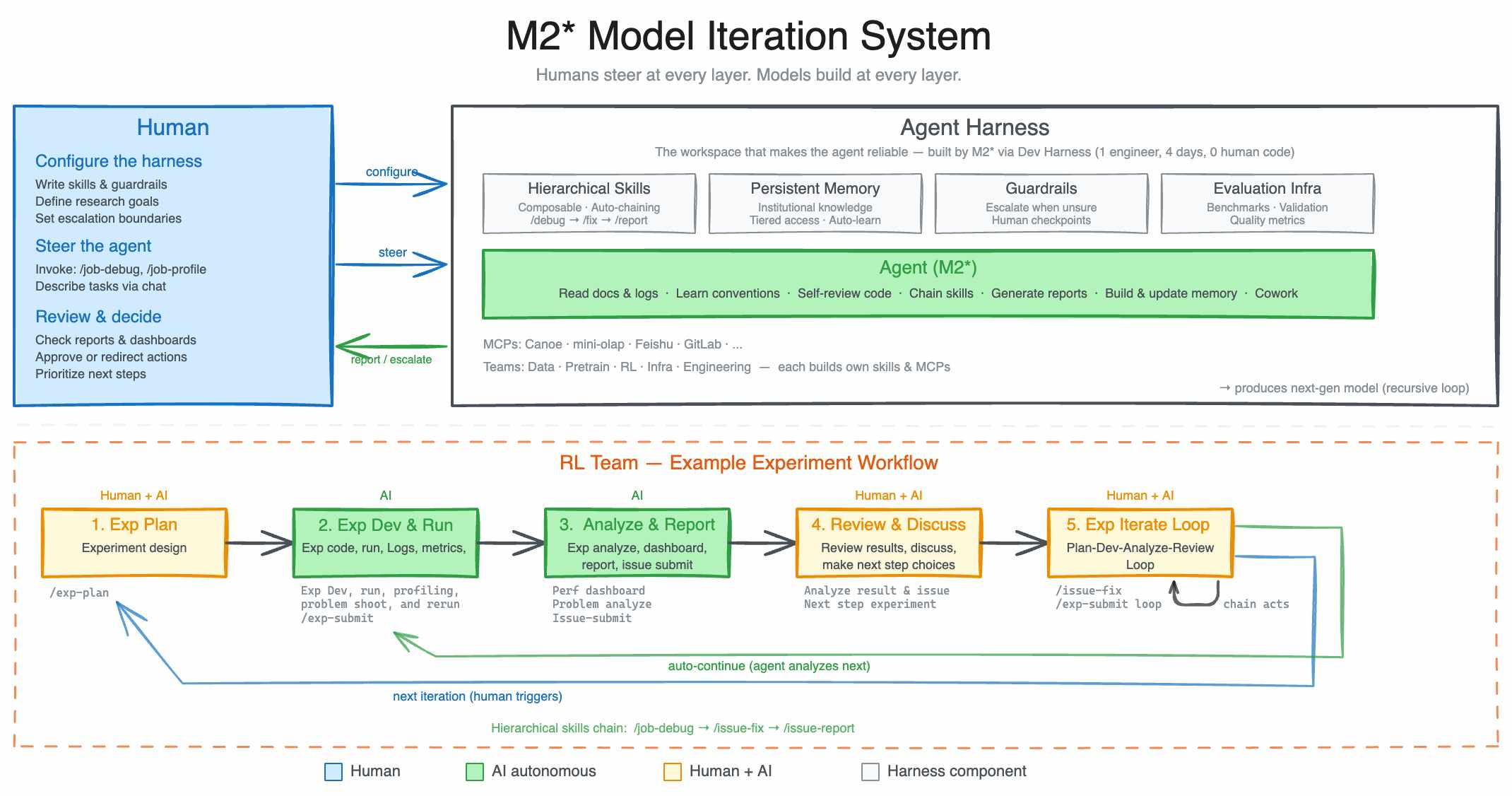

构建模型自我进化智能体

传统AI模型的迭代完全依赖人类工程师,而M2.7开创了一种新模式——模型自主参与迭代过程。

在RL场景中,研究员从实验想法出发,Agent自动完成文献调研、实验规格跟踪、数据流水线对接、实验启动。运行期间,它还会自动监控分析实验状态,触发日志读取、问题排查、指标分析、代码修复、合并请求及冒烟测试。在这个场景下,M2.7能够胜任30-50%的工作流。

M2.7全程自主运行,执行”分析失败轨迹 → 规划改动 → 修改代码 → 运行评测 → 对比结果 → 决定保留或回退”的迭代循环超过100轮。最终在内部评测集上效果提升30%。

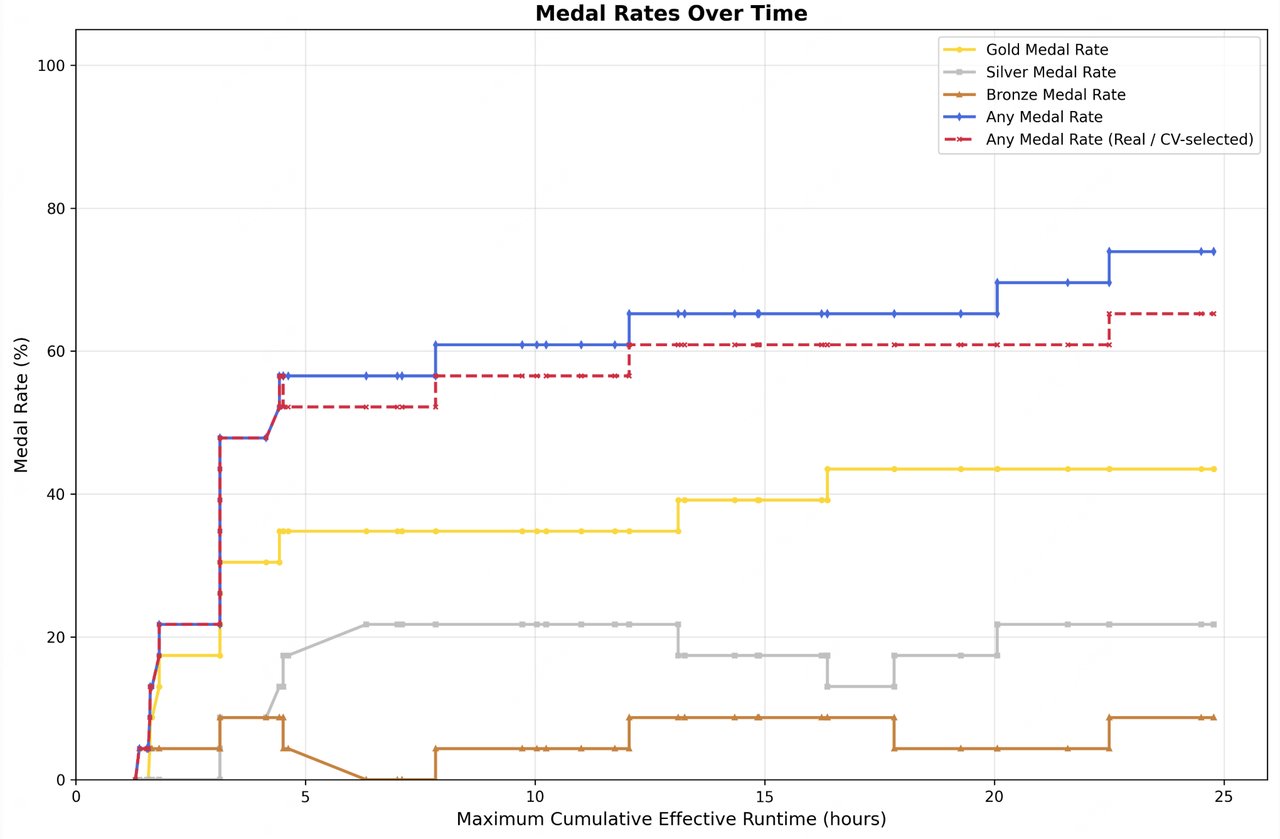

MLE Bench:三次测试平均66.6%得牌率

MiniMax用M2.7参与了MLE Bench Lite的22个机器学习任务测试。设计和实现了包含短时记忆、自反馈、自优化三个核心模块的脚手架。

测试三次,每次24小时迭代进化,最好的一次取得9枚金牌、5枚银牌、1枚铜牌。三次平均得牌率66.6%,仅次于Opus-4.6(75.7%)和GPT-5.4(71.2%),与Gemini-3.1持平。

Agent Teams:原生多智能体协作

原生的Agent Teams能力是M2.7的重要特性,对模型提出了范式级要求:角色边界、对抗性推理、协议遵循、行为分化——这些无法通过提示词,必须内化为模型的原生能力。

在Agent Teams场景下,模型需要稳定锚定角色身份、主动挑战队友的逻辑与伦理盲区、在复杂状态机中自主决策。

互动娱乐:OpenRoom开源

MiniMax还构建了Agent交互系统OpenRoom,将AI互动置入一个万物皆可互动的Web GUI空间,对话即驱动,实时产生视觉反馈与场景交互。

项目已开源:github.com/MiniMax-AI/OpenRoom

在线体验:openroom.ai

上线与体验

- MiniMax Agent:agent.minimaxi.com

- API服务:platform.minimaxi.com

- Coding Plan订阅:platform.minimaxi.com/subscribe/coding-plan

总结

M2.7的核心突破在于自我进化能力——模型不再是被动执行指令的工具,而是能自主分析问题、制定方案、优化迭代的”AI同事”。

- 软件工程能力追平GPT-5.3-Codex(56.22%)

- Agent Teams原生能力让多智能体协作成为可能

- 100+轮自主迭代,内部评测集效果提升30%

- MLE Bench得牌率66.6%,仅次于Opus-4.6和GPT-5.4

- 复杂skills遵循率保持97%

对于正在使用OpenClaw的用户,M2.7值得关注。它标志着AI从”被动响应”向”主动判断”的转变正在成为现实。

© 版权声明

本站部分内容源于网络收集,文章等版权归原作者所有,若需删稿请联系管理员邮箱:[email protected]

相关文章

暂无评论...