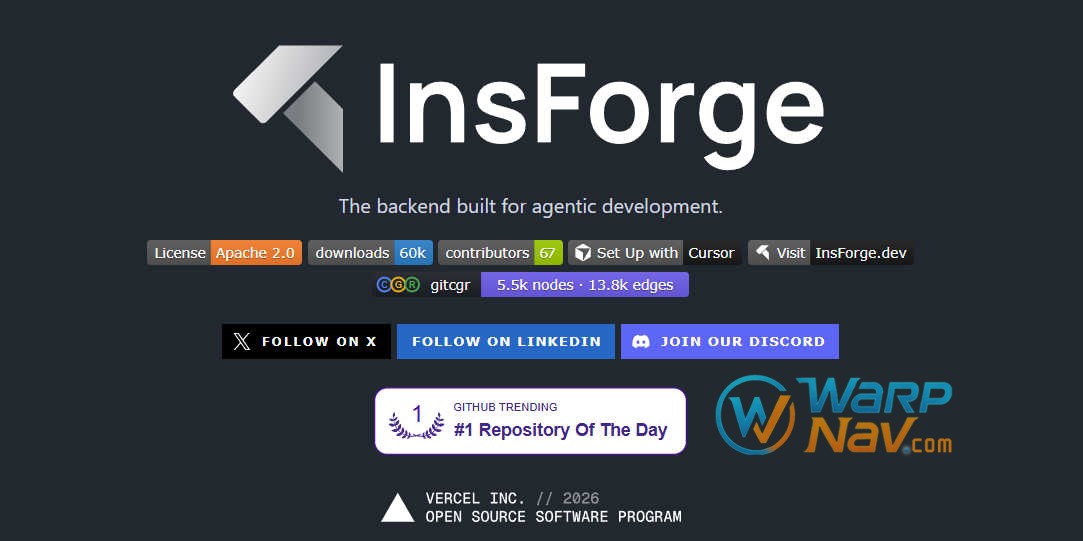

InsForge 是一个专为 AI 编程代理(AI coding agents)设计的后端开发平台。它的核心思路很简单:把后端开发中那些繁琐的基础设施(数据库、用户认证、文件存储、API 网关)打包成 AI 能理解的语义接口,让 AI 代理能够自主完成全栈应用的开发、部署和运维,而不需要人工介入底层配置。

GitHub 仓库目前保持 7.3k Stars、581 Fork,有 70 位贡献者参与,基于 Apache-2.0 许可证开源。

相关链接

- GitHub 仓库:https://github.com/InsForge/InsForge

- 官方网站:https://insforge.dev

- 云端版本:https://insforge.dev(开箱即用,无需自托管)

InsForge 是什么

InsForge 本质上是一个后端语义层。传统开发中,AI 编程代理想要操作后端资源,需要依赖开发者预先配置好的 API 接口,或者自己写复杂的后端代码。InsForge 把这套流程反过来——平台把后端能力封装成结构化语义,AI 代理通过 MCP(Model Context Protocol)协议直接感知、配置和操作后端系统。

它的设计目标是:让 AI 代理能够自主理解后端有什么、怎么配、状态是什么,而不只是机械地执行人类写好的指令。

核心功能

- Authentication:内置用户管理系统,支持 GitHub OAuth、Google OAuth,提供完整的登录、会话、权限管理

- Database:基于 Postgres 的关系数据库,预配置了常用 Schema,支持 pgvector 向量检索

- Storage:S3 兼容文件存储,AI 可以直接上传和读取文件

- Model Gateway:统一的 LLM API 网关,支持 OpenAI 兼容接口,可接入多种大模型提供商

- Edge Functions:基于 Deno 的边缘函数,支持无服务器部署

- Site Deployment:网站构建和部署功能,支持前后端一体部署

AI 代理如何与 InsForge 协作

InsForge 为 AI 编程代理提供了三个维度的能力:

- 获取后端上下文(Fetch backend context):AI 代理可以查询 InsForge 的文档和可用操作,了解当前后端有哪些能力

- 配置后端资源(Configure primitives):AI 代理可以直接配置数据库 Schema、存储规则、认证策略等后端资源

- 检查后端状态(Inspect backend state):数据库内容、存储文件、运行日志都通过结构化 Schema 暴露,AI 能实时感知后端状态

快速部署

云端版本(推荐,无需安装)

访问 https://insforge.dev,注册账号后直接使用,无需配置任何环境。

Docker 自托管

git clone https://github.com/InsForge/InsForge.git

cd InsForge

cp .env.example .env

docker compose -f docker-compose.prod.yml up一键部署平台

支持在 Railway、Zeabur、Sealos 上直接一键部署,无需本地安装 Docker。

连接 AI 代理(MCP)

部署完成后,打开 http://localhost:7130,按照指引连接 AI 编程代理。验证连接的测试指令:

I'm using InsForge as my backend platform, call InsForge MCP's fetch-docs tool to learn about InsForge instructions.运行多个独立项目

同一个主机上可以运行多个相互隔离的 InsForge 实例,通过不同端口和项目名区分:

cp .env.example .env.project1

cp .env.example .env.project2

# 修改 .env.project2 的端口:POSTGRES_PORT=5442, APP_PORT=7230, AUTH_PORT=7231

docker compose -f docker-compose.prod.yml --env-file .env.project1 -p project1 up -d

docker compose -f docker-compose.prod.yml --env-file .env.project2 -p project2 up -d技术栈

- 后端:Node.js / Express

- 边缘函数:Deno

- 数据库:PostgreSQL + pgvector(向量检索)

- 存储:S3 兼容(MinIO / AWS S3)

- AI 协议:MCP(Model Context Protocol)

- 部署:Docker Compose / Railway / Zeabur / Sealos

- 许可证:Apache-2.0

适用人群

- AI 编程代理开发者:正在构建 AI 代码助手、AI 代理平台,需要配套后端能力

- AI 应用全栈工程师:需要快速为 AI 应用搭建用户系统、数据库、存储等基础设施

- Claude Code / Cursor 用户:想让 AI 编程代理拥有完整的后端开发和部署能力

- 独立开发者:不想花时间在后端配置上,直接用 AI 生成完整应用

总结

InsForge 解决的是一个很具体的问题:AI 编程代理缺一个现成的后端。它不是又一个”5分钟搭建全栈应用”的框架,而是专门为 AI 代理设计的后端语义层。通过 MCP 协议,AI 能够自主感知和操作后端资源,真正实现”让 AI 自己开发、部署、维护应用”的闭环。如果你正在做 AI 编程代理相关的项目,InsForge 值得一试。

© 版权声明

本站部分内容源于网络收集,文章等版权归原作者所有,若需删稿请联系管理员邮箱:[email protected]

![[Github发现] OpenStock – 开源股票市场追踪平台,10.3k Stars 的免费替代方案](https://wn.zmoyun.com/wp-content/uploads/2026/04/1775552279-Snp_2026-04-07-165735.jpg)

![[Github发现] OpenViking – 火山引擎开源的 AI Agent 上下文数据库](https://wn.zmoyun.com/wp-content/uploads/2026/03/1773560364-openviking-website-featured.jpg)

![[Github发现] Dexter – 自主式金融研究Agent,像资深分析师一样思考、计划、学习](https://wn.zmoyun.com/wp-content/uploads/2026/03/1774776948-Snp_2026-03-29-173517.jpg)

![[Github发现] PDFMathTranslate – 完整保留排版的PDF学术论文双语翻译工具](https://wn.zmoyun.com/wp-content/uploads/2026/03/1774946816-Snp_2026-03-31-164640.jpg)

正想给团队里几个 AI 编程代理分别配独立的后端环境,研究一下